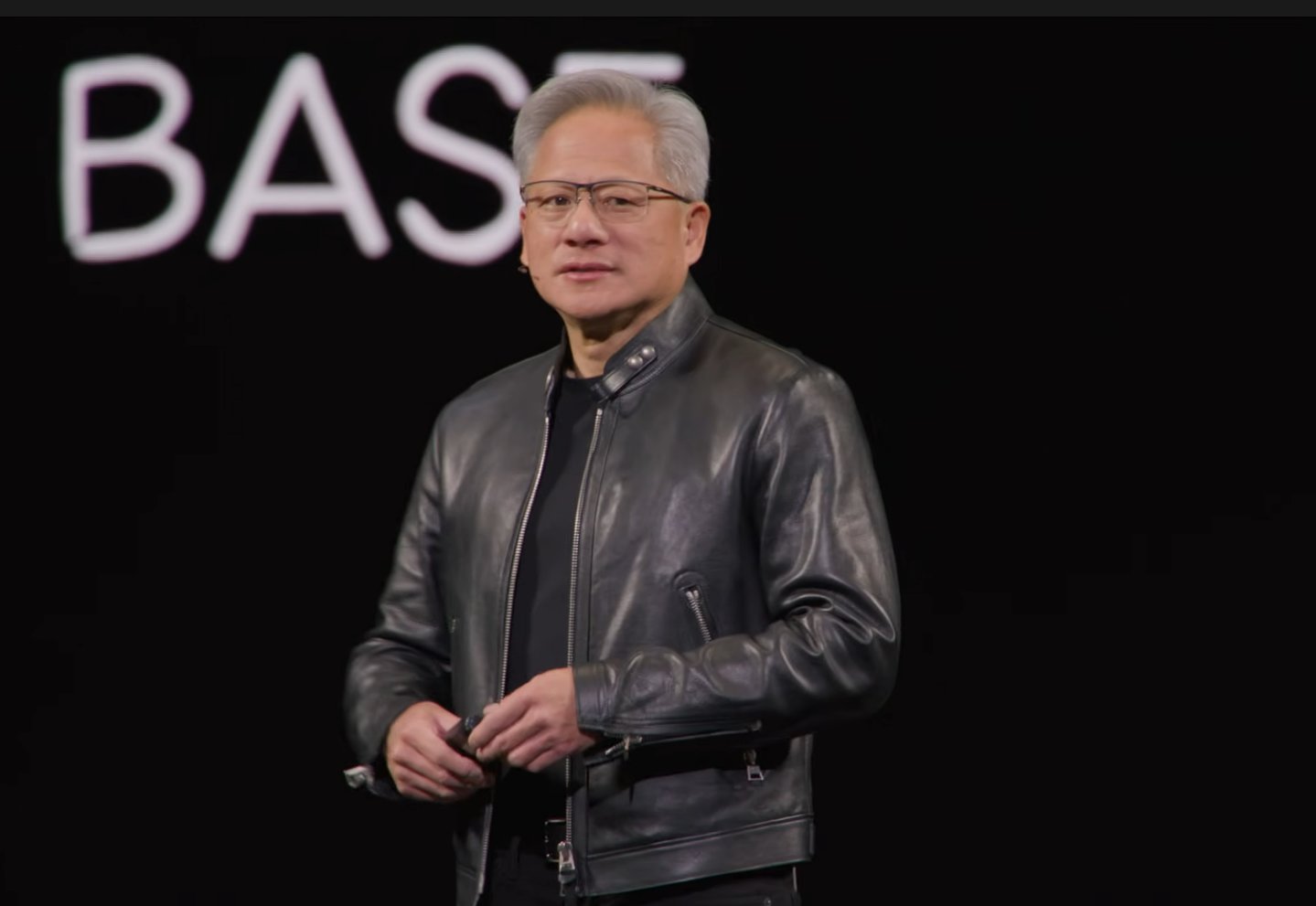

北京时间 3 月 17 日凌晨,英伟达 CEO 黄仁勋在 GTC 2026 大会上发表了长达两个半小时的演讲。这场盛会没有让资本市场失望,黄仁勋在现场给出了一个明确的财务预期:到 2027 年,英伟达旗舰算力芯片将带来 1 万亿美元的营收。

一万亿美元是什么概念?

这相当于全球 IT 基础设施预算的一次大换血。

为了证明这并非空谈,英伟达一口气发布了包含 Vera CPU、Groq 3 LPX 推理机架、NemoClaw 企业级智能体平台在内的产品矩阵。

剥开这些硬核参数,我们发现黄仁勋卖的早就不是单一的 GPU,而是试图通过软硬件协同,全面主导未来数字经济的底层基建。

1. 算账逻辑的变化:从数据中心到 「Token 工厂」

黄仁勋在演讲中提出的一个核心观点是:过去用来存储和流转信息的数据中心已经成为历史。在生成式 AI 时代,算力节点将变成生产 AI 推理代币 (Token) 的 「工厂」。

既然是工厂,核心就是如何压缩单位产品的制造成本。这正是本次 GTC 大会上英伟达核心硬件变量——Groq 3 LPX 推理机架诞生的原因。

过去,企业用通用 GPU 做大模型推理,成本居高不下。现在,英伟达走向了专芯专用:GPU 凭借并行计算能力,负责模型庞大的预填充 (Pre-fill);而搭载了 256 个 LPU(语言处理单元) 的 Groq 3 LPX 机架,凭借 128GB 的片上 SRAM 和 640TB/s 的带宽,专门处理低延迟的 Token 解码。

在这种分工下,系统的推理吞吐量与功耗比提升了 35 倍。这意味着,英伟达正通过底层架构的调整,把生成 Token 的成本大幅压低,从而改变 AI 产业的盈利模型。

2. 基建扩容:为 「数字员工」 修筑信息高速

明确了 「Token 工厂」 的定位后,黄仁勋提出了 AI 的 「五层架构」(能源、芯片、基础设施、模型、应用),这本质上是一场类似电气化改造的基建工程。

在这场建设中,未来的企业软件将全面转向 「智能体 AI(Agentic AI)」。但智能体要真正介入企业业务,必须具备 「长上下文推理 (Long-context reasoning)」 能力。通俗来说,就是要让 AI 能快速读完并处理几十万字的企业财报或复杂代码,且保持系统稳定。

为此,英伟达发布了专为智能体定制的 Vera CPU(计算效率较传统机架提升 2 倍,速度提升 50%),以及全新的 BlueField-4 STX 存储架构和 Spectrum-6 SPX 光电互联系统(采用 CPO 共封装光学技术,光功率效率提升 5 倍,网络可靠性提升 10 倍)。

这套组合拳,相当于为未来庞大的 AI 数据流,提前铺设了一条高带宽的信息高速公路。

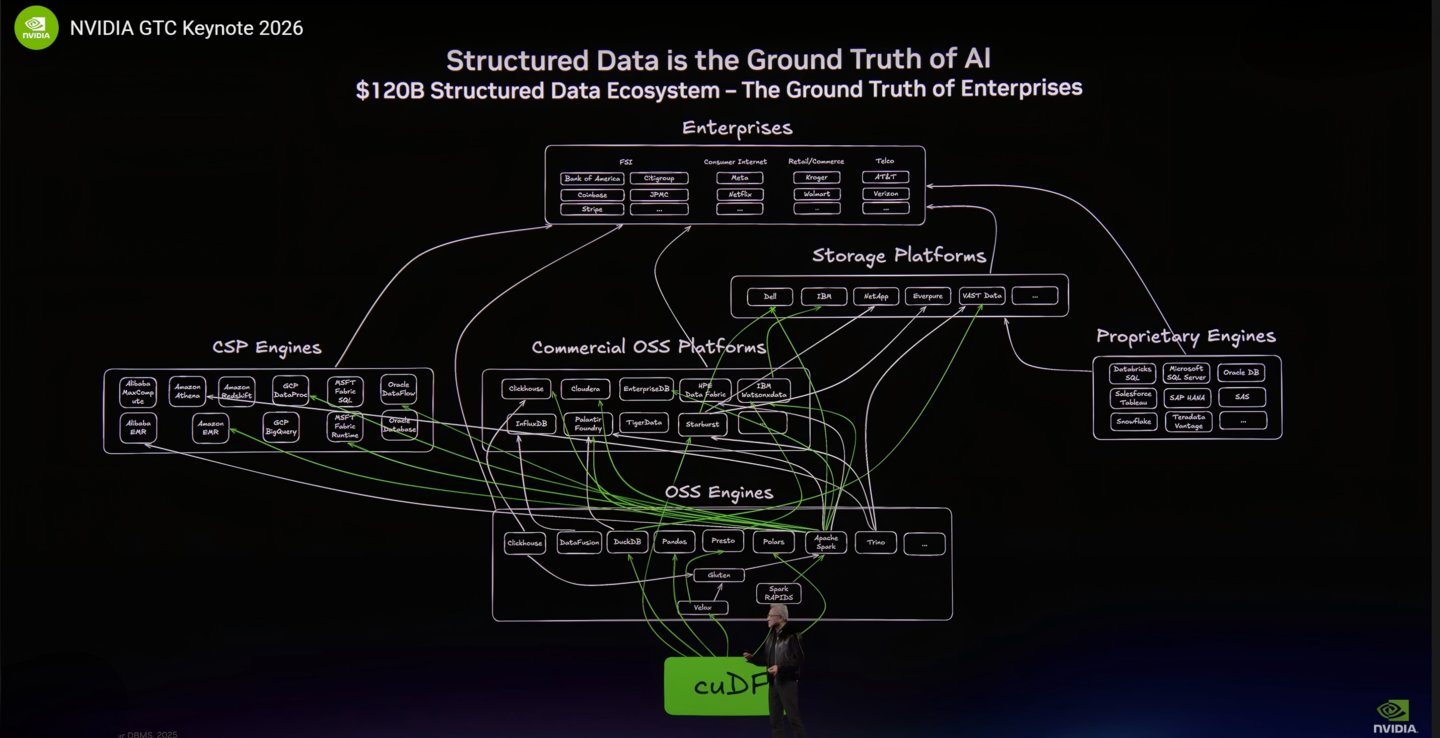

3. 软件标准与生态包抄:谁来定义企业级 「龙虾」?

硬件铺好后,英伟达顺势用软件生态来巩固自身壁垒。

最近两个月,开源智能体 OpenClaw(网络俗称 「龙虾」) 在全球走红,但较高的部署门槛和内网安全隐患,让许多企业持观望态度。当中国市场还在探讨如何把 「龙虾」 的配置时间从 6 小时缩短到 10 分钟、如何平衡执行效率与安全红线时,英伟达直接给出了企业级方案:推出 NemoClaw 智能体基础设施。

NemoClaw 支持企业用 「一条命令」 部署 AI 代理,并在底层内置了内网隐私数据路由与安全沙箱机制。为了配合这个平台,英伟达还联合顶尖实验室,推出了拥有 1200 亿参数 (激活 120 亿) 的开源模型 Nemotron 3 Super,专为运行复杂的智能体系统设计,能带来 5 倍的吞吐量提升。

这是一种严密的生态卡位,英伟达已经提前把这些智能体的调度规则、安全边界甚至图形渲染标准 (本次发布的 DLSS 5 技术,被称为图形领域的 「GPT 时刻」),掌握在了自己手中。

看懂了上述布局,我们再回过头来看黄仁勋开篇那个 「1 万亿美元」 的财务预测。

英伟达正在做的事情,不仅是卖 「发电机」(算力芯片),还要修 「输电网」(光电互联与存储架构),甚至连 「用电器」(企业级智能体平台) 的接口标准都要由它来制定。

同时,本次大会还推出了 Space-1 Vera Rubin 太空计算模组,将算力网络延伸到了近地轨道。当它全面渗透进全人类迈入智能体时代的物理和软件基建时,那 「1 万亿美元」 的预期,就不再是一句空喊的口号。

附:GTC 2026 英伟达核心硬软件发布简报

一、 核心算力与处理器

- Vera Rubin 平台: 全新一代 AI 工厂平台,包含的 7 款新芯片现已全面进入量产阶段。

- Vera CPU: 全球首款专为智能体 AI 和强化学习定制的处理器。计算效率是传统机架级 CPU 的 2 倍,运行速度提升 50%。

- Groq 3 LPX 推理机架: 搭载 256 个 LPU(语言处理单元),提供 128GB 片上 SRAM 和 640TB/s 带宽。在 「GPU+LPU」 协同下,推理吞吐量与功耗比提升 35 倍。

二、 数据互联与存储基建

- BlueField-4 STX 存储架构: 模块化参考架构,专为解决智能体 AI 所需的 「长上下文推理」 数据吞吐问题而设计。

- Spectrum-6 SPX 光电互联: 采用 CPO(共封装光学) 技术,光功率效率提升 5 倍,网络可靠性提升 10 倍。

三、 企业软件与模型生态

- Nemotron 3 Super 模型: 1200 亿参数 (激活参数 120 亿) 的开源大模型,专为复杂智能体系统设计,吞吐量提升 5 倍。

- NemoClaw 智能体平台: 企业级 OpenClaw 基础设施。支持 「一条命令」 部署 AI 代理,集成隐私路由与安全沙箱功能。

四、 前沿场景与图形渲染

- Space-1 太空计算模组: 专为卫星和轨道数据中心 (ODC) 设计,支持在轨实时推理和边缘计算。

- DLSS 5 图形技术: 引入生成式 AI 补全图像像素,大幅降低本地渲染算力消耗,被官方称为自 2018 年实时光线追踪以来计算机图形领域的最大突破 (「GPT 时刻」)。(本文首发钛媒体 App, 作者|硅谷 Technews,编辑|秦聪慧)