文 | 字母 AI

Codex 做了一次很大的更新,从一个代码编写工具变成了能操作电脑的助手。

官方用了一句很夸张的话作为宣传:「Codex for (almost) everything.」

简单地说,过去的 Codex 作为编码工具,边界一直还算清晰:你提出需求,它生成代码。

但这次更新之后,这个边界被狠狠扩展了。

它开始操作你的电脑,使用应用,在不同工具之间来回切换;它可以把任务留到几天之后再继续,也能根据你过去的习惯,给出下一步该做什么的建议。

这些能力拼在一起,让 Codex 有了龙虾 (OpenClaw) 的既视感。

它开始 「工作」 了。

从写代码到 「动手干活」

这次更新最核心的亮点是,Codex 开始直接操作电脑了。

按官方的说法,Codex 现在可以通过 「看到屏幕、点击鼠标、输入键盘」 的方式,直接使用你电脑上的应用。它会用自己的光标,在界面上完成操作,而不是调用 API 接口。

可以这么理解:过去 AI 通常依赖 API 接口来完成工作,一旦遇到没有接口的工具,比如设计软件、本地应用、内部系统等等,它的能力就会受限。

但现在,它可以绕过这些限制,直接在界面上动手。

而且这种操作并不会打断你当前的工作,多个 Agent 可以在后台并行运行,在不同应用之间切换,用户依然可以正常使用电脑。

这个功能目前在 macOS 抢先上线,其它系统还需要再等待一段时间。

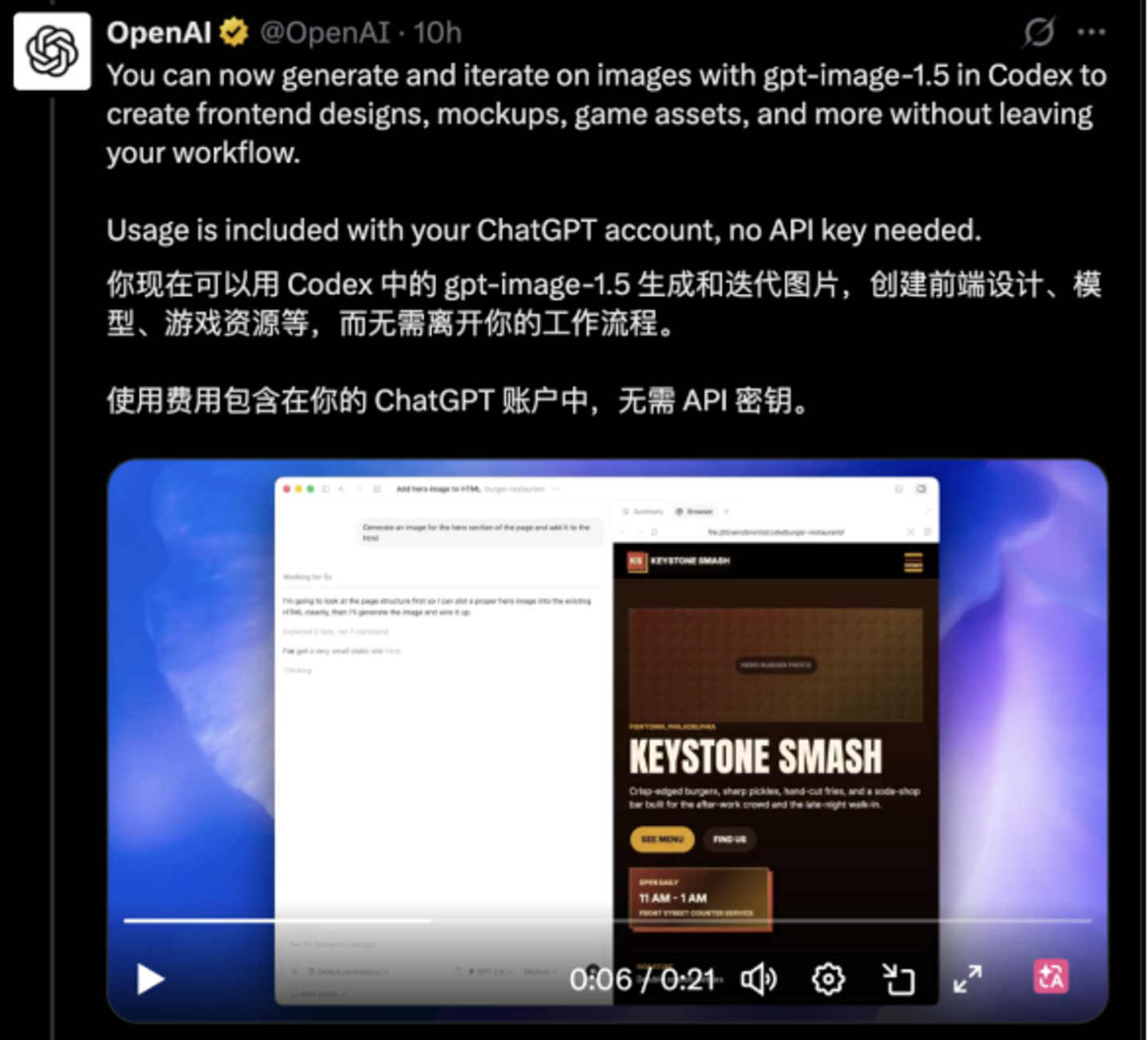

除此之外,这一版本的 Codex 开始直接接入网页。

桌面应用内置了浏览器,你可以在页面上圈出某个按钮、某一段区域,甚至直接写下评论,把 「位置」 本身变成指令,让它据此修改界面、调整逻辑或检查问题。

这个功能对前端设计和游戏开发非常有用,如果原本是用 Codex 生成的代码,在生成的界面上直接标注就好。

官方文档显示,他们计划随着时间推移扩展这一功能,使 Codex 能更完整地控制浏览器,不再局限于本地运行的网页应用。

同时还添加了原生的图像生成功能:Codex 现在可以使用 gpt-image-1.5 生成和迭代图像,用于产品设计、界面草图或游戏素材,不需要额外接 API。

围绕开发流程本身,这次更新把很多原本分散的环节也补上了,例如可以处理 GitHub 的评审评论;打开多个终端标签;通过 SSH 连接远程开发环境;在侧边栏直接预览 PDF、表格和文档。

还有一个汇总面板,可以看到当前在做什么、用了哪些信息、产出了什么结果。

这些能力并不完全是从零开始的新功能,只是以前零散存在,现在被放进了 Codex 的整个开发流程里。

Codex 还扩展了插件和工具集成,接入了 90 多个插件,包括 JIRA、GitLab、Microsoft 套件等等。

任务开始跨工具流动,而不是停在某一个应用里。你可以一句话让它同时查 Slack、Gmail、Notion,再给你一个需要处理的事情列表。

还有一个很关键的升级是,Codex 现在可以把任务 「留到以后再做」。

它可以复用已有的上下文,在未来某个时间点自动继续执行任务,整个过程可以跨越几天甚至几周。

也就是说,之前已经完成的整理、讨论过的问题,以及还没做完的工作,都不会被丢掉。它们可以被带入下一步,成为后续任务的一部分。

与此同时,记忆能力也开始生效。Codex 会记录你的偏好、修改习惯以及已经整理过的信息,让后续任务在不需要反复说明的情况下继续推进,并逐渐贴合你的工作方式。

当它掌握了足够的上下文之后,Codex 就可以从不同工具中提取信息,识别出需要处理的评论或任务,整理出一份有优先级的行动建议,告诉你应该从哪里开始继续一个项目。

不只是功能升级

上面罗列的很多功能乍一看可能互不搭嘎,但它们指向了同一个变化:工作流。

过去,Codex 存在于某一个具体环节里,写代码、改代码、解释代码。你需要在不同工具之间来回切换,把任务拆成一段一段再交给它完成。

但现在这些事情开始连在一起了:它可以在应用里执行操作,在网页中获取信息,在终端里运行命令,再把结果带回到代码里;它也可以把这些步骤延续下去,在几天之后继续推进同一个任务。

可以说,原本分散在不同工具、不同时间里的工作,开始被串成一条连续的流程,被收在了一个系统里。

原生的 Mac 集成,让 Codex 可以操作你的电脑,在本地环境中操作应用、协调任务,并在不同工具之间流转信息。

它没有取代原本的应用,但开始在这些应用之间流动,把任务从一个地方带到另一个地方。

这也是为什么有人会认为,Codex 正在变成知识工作的」 操作系统 「。

另外,相比接入更多应用,有人认为记忆能力可能才是这次更新的关键。

因为一旦 AI 开始理解你的工作方式,并在后续任务中复用这些信息,它会逐渐贴合你的习惯,让你用得越来越顺手。

这确实指向了一个趋势:未来的 AI 竞争,可能不只是模型能力本身,还是谁能更深入地嵌入你的工作流程,并持续理解你是如何完成工作的。

「超级应用」

说到深入工作流的能力,很多人可能会觉得和 OpenClaw 很相似,两者的方向确实一致,都是让 AI 去完成任务,而不是只回答问题。

不同的地方在于,OpenClaw 更偏 「调用工具」,通过接口把流程串起来;而 Codex 这次更新把 AI 放进了系统内部,让它直接操作应用。

所以会说它是 「龙虾」 上身——把这套逻辑并入系统里,可不是上身么。

这种相似或许和 Peter Steinberger(OpenClaw 创始人) 加入 OpenAI 有点关系,不过更可能的情况是 OpenAI 本身就想做生态整合,做一个能搞定所有事情的 「超级应用」(super app)。

据 OpenAI 官方统计,Codex 现在每周有超过 300 万用户,其中有近一半的使用是非编码任务。它的使用场景已经不再局限于代码,这次的更新可能就是 OpenAI 想做 「超级应用」 的第一步。

从上线节奏来看,这次更新也在分阶段推进:桌面控制的功能目前只在 macOS 上推出;记忆和上下文感知建议的功能先开放给美国用户,欧盟、英国、教育版、企业版稍后。

能力还在铺开,但方向已经很明确了:Codex 正在从一个写代码的工具,变成一个可以跨应用、跨时间持续完成任务的系统。

这条路也不只是 OpenAI 在走,几乎是同一时间,Perplexity AI 也发布了名为 「Personal Computer」 的 Mac 桌面应用,同样在尝试把本地文件、原生应用和浏览器操作整合在一起,让 AI 可以在一个统一环境中执行任务。顺便一提,最近更新的 Claude Opus 4.7 已成为 Personal Computer 的默认协作 (orchestration) 模型。

而 Anthropic,他们的产品本身已经具备较强的 Agent 能力,可以调用工具、执行多步任务,但更多集中在开发环境和工具调用层面,暂时还没有形成一个直接操作桌面应用的统一系统。

国内的趋势也大致相同:几乎所有大厂都在布局类似 OpenClaw 的 Agent 体系,同时也开始尝试让 AI 直接操作本地环境、执行任务。

说白了,目标都是让 AI 不再停留在对话里,能够进入实际的工作环境。

从聊天到写代码,到操作应用,再到跨时间推进工作,当 AI 开始 「动手」,工作方式就发生了变化。

「龙虾」 上身的 Codex,只是其中一步。