文 / 节点 AI 观 ,作者 | 道哥

美国当地时间 1 月 5 日,英伟达 CEO 黄仁勋率在拉斯维加斯枫丹白露酒店的剧场中心举行新年的第一场演讲。依然是那身熟悉的皮衣。

通常情况下,英伟达会在春季于硅谷举行的开发者大会上详细介绍其最新芯片的规格和性能。但黄仁勋表示,由于人工智能所需的计算复杂度不断提高,以及市场对先进处理器用于训练和运行 AI 模型的巨大需求,整个半导体行业不得不加快步伐。

在总结 2025 年这一年变化时,黄仁勋特意提到了 DeepSeek R1 的出现意外起到的催化剂作用,另外,在他身后的 PPT 上,还展示了中国开源模型 Kimi K2 和 Qwen。

整个演讲持续一个半小时,仔细看来,这场大会信息密度极高。节点 AI 总结了下分别是 Agentic AI、物理 AI、新芯片三大关键词。

01 芯片新架构 Vera Rubin 全面投产

虽然芯片新架构出现在演讲后半程,但算力作为 AI 的心脏,小编认为还是有必要提前点出:

这次大会上,英伟达发布了一套由六个部分组成的 Rubin 平台—— 包括 Rubin 和 Rubin Ultra 两种规格的 GPU 与 CPU,以及 NVLink 6 交换芯片和 ConnectX-9 SuperNIC。

这款新服务器专为处理创建此类模拟而设计,能将其用于模型训练所需的海量计算负载。命名由来是,20 世纪中期美国天文学家 Vera Rubin,她曾通过对天体运动的开创性观测取得重大科学突破。

黄仁勋评价,每一颗芯片都是革命性的,都值得单独开一场发布会。

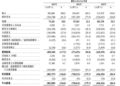

从公开数据来看性能惊人:

其中,Rubin GPU 的 NVFP4(4 位浮点数格式) 推理算力为 50PFLOPS,是 Blackwell 的 5 倍;NVFP4 训练算力是 35PFLOPS,是 Blackwell 的 3.5 倍;HBM4 内存带宽 22TB/s,是 Blackwell 的 2.8 倍,晶体管数量 3360 亿个,是 Blackwell 的 1.6 倍。与 Blackwell 平台相比,Rubin 平台通过软硬件协同设计,将推理 token 成本降低 10 倍,将训练 MoE 模型 (专家模型) 所需的 GPU 数量减少 4 倍。

“ 如果我们不做协同设计,即便在每年提升 1.6 倍晶体管数量的最好情况下,以及在每个晶体管性能提升一些,例如提升 25% 的情况下,也难以获得巨大的性能提升。” 黄仁勋表示,这就是为什么要做另外一些事情,例如推出 NVFP4,以便在可以损失精度的地方实现更高的吞吐量。这种协同设计,使新的芯片平台可以有比较大的性能提升。

从商业化步伐来看,英伟达下一代 AI 超级芯片平台 Vera Rubin 已进入全面量产,2026 年下半年开始向合作伙伴交付,AWS、Google Cloud、Microsoft、Oracle 等主要云服务商已确认部署。

02 剑指 Agentic AI

有了充足的燃料—— 算力,软件层才有想象空间。

如果说近年来 AI 领域最热门的概念有哪些,Agentic AI 绝对位列其中。

现在英伟达在试图为企业们降低 Agent 的开发成本。

英伟达称,其发布的 Nemotron-CC,是一个多语言预训练语料库,覆盖 140 多种语言,总规模达 1.4 万亿 token,被定位为构建和微调模型的“ 开放” 基础层。

公司同时强调了一套名为“Granary” 的指令数据集,目标是让模型在企业级任务上“ 开箱即用”

从现场展示来看,利用英伟达的硬件和框架,开发者在几分钟内就能构建出一个功能完整的个人助理。这在几年前是不可想象的,而现在,它变得易如反掌。

英伟达加入开源运动的原因不难理解,是希望用“ 免费样品” 把开发者吸引进自家生态,这样反而能巩固硬件的优势。

事实上,近年来英伟达一直致力于丰富开源生态。用英伟达生成式 AI 与软件副总裁 Kari Briski 的话所说,此次大会的发布是一次“ 扩展”。

“ 在 2025 年,英伟达是 Hugging Face 上最大的贡献者之一—— 发布了 650 个开放模型和 250 个开放数据集。”Briski 表示。

对企业而言,Agent 门槛的降低对未来的影响十分深远。未来的 IT 部门,或许会将人类员工从繁琐的流程中解放出来。工作内容将变成“ 招募、管理和优化” 各种 AI 数字代理。

这正是 AI Agent 的终极魅力,从被动的数据喂养,变成了一个能够主动解决问题的数字员工,为企业创造极高的效率和价值。

03 接棒 LLM,物理 AI 是下个主角

如果 Agent 是软件层面的智能面,那么物理 AI—— 这次演讲的重头戏,就是联动现实世界与物理世界的全新应用场景。从黄仁勋的规划来看,自动驾驶、机器人、工业制造将是首推的三大场景。

黄仁勋强调表示,英伟达已为物理 AI 工作了 8 年。他认为,物理 AI 的 ChatGPT 时刻即将到来。

而仿真是英伟达几乎所有物理 AI 工作的核心—— 英伟达通过其 Omniverse 平台,构建了一个与现实世界几乎一模一样的“ 数字孪生” 环境。在这个虚拟世界里,AI 可以安全、高效地进行训练。

黄仁勋强调,这一多层次的技术栈,正推动 AI 从屏幕内的对话者,转变为能够在现实世界中执行任务的行动者。

最先试验的落地场景就是对安全系数要求极高的自动驾驶。

此次英伟达推出开源推理 VLA 模型 Alpamayo,该模型系列包含开源 AI 模型、仿真工具和数据集,可加速基于推理的、安全的自动驾驶车辆开发,这是英伟达 AV 团队数千人的工作成果。

“ 我想我们都同意,从非自动驾驶汽车到自动驾驶汽车的转折点,可能就发生在这个时候。” 黄仁勋表示,未来十年里,可以相当肯定,世界上很大一部分汽车将是自动驾驶或高度自动驾驶的。

从落地效果来看,英伟达 DRIVE AV 软件将在梅赛德斯奔驰车辆上使用,相关的 AV 自动驾驶汽车刚投入生产。第一辆 AV 自动驾驶汽车将在今年第一季度在美国上路,第二季度进入欧洲,第三或第四季度进入亚洲。英伟达还将继续更新版本,合作建造 L4 Robotaxi 的生态系统还在扩大。

机器人方面,面向智能机器人的推理视觉语言模型 (VLM)Isaac GR00T N1.6 等,还有多个用于机器人开发的新开源框架。

除了专门的硬件设备,黄仁勋还将目光投向了工业级场景。

黄仁勋宣布了与西门子深化合作,将英伟达的物理 AI 模型、Omniverse 仿真平台集成至西门子的工业软件组合,覆盖从芯片设计、工厂模拟到生产运营的全生命周期。

“ 我们正站在一场新工业革命的开端,” 他表示。物理 AI 将赋能芯片设计、生产线自动化乃至整个数字孪生系统,实现“ 在计算机中设计、在计算机中制造”。

与其说是产品发布会,倒不如说是,黄仁勋本人对 AI 及计算产业未来十年的预判与宣言。通过开源关键模型、发布颠覆性硬件,英伟达试图强势定义,下个 AI 时代的技术标准与基础设施。

其战略核心也延续以往英伟达的开源+软硬一体的作风,以全栈式的开放生态,牢牢占据从数据中心到智能终端的每一个计算节点,不放过任何一个有可能巩固护城河的机会。

更多精彩内容,关注钛媒体微信号 (ID:taimeiti),或者下载钛媒体 App