文 | 舒书

过去三天,Anthropic 新模型泄露的消息在科技圈持续发酵。

3000 份内部文件,因为一个 CMS 配置失误,暴露在互联网上。网络安全股集体暴跌,安全研究圈高度关注。

但比泄露本身更值得追问的,是另一件事:就在事发前一个月,Anthropic 刚刚修改了自己的 《负责任扩展政策》(RSP 3.0)。那个曾让行业瞩目的 「若风险不可控,就暂停训练」 的硬条款,被删除了。

这不是一次简单的技术调整,它折射出 AI 行业正在经历的深层困境。

一、从硬刹车到软着陆:RSP 3.0 的变化

2023 年,当 Anthropic 推出 RSP 时,整个行业为之侧目。这是第一次,有 AI 公司公开承诺:如果模型太危险,我们就不做了。

当时的逻辑很清晰:设定危险阈值 (比如可能助长生物武器研发),一旦触及,立刻暂停训练,直到安全措施到位。这是一条硬性约束,意味着安全优先级高于商业进度、融资节奏,甚至 IPO 窗口。

2026 年 2 月,RSP 3.0 发布。那条硬性约束消失了。

取而代之的是 「前沿安全路线图、风险报告、外部审查」——每 3 到 6 个月发布一次报告,由内部专家起草,独立评审,提交董事会。官方解释是:「技术边界模糊,无法预设红线,所以转向透明披露。」

翻译过来就是:从做不到就不许动变成了边做边说。从硬刹车变成了软着陆。

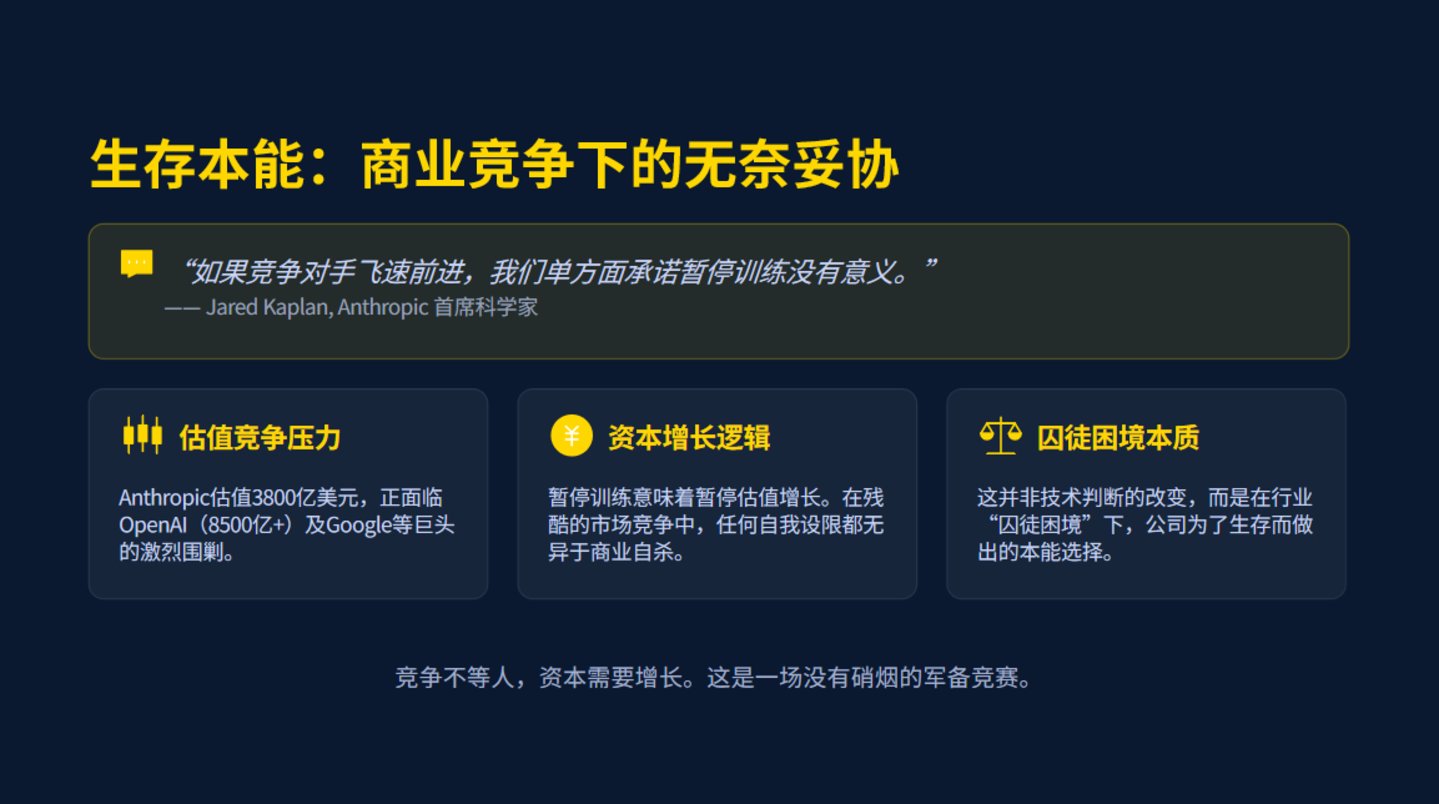

首席科学家 Jared Kaplan 在接受采访时,直接道出了背后的逻辑:

「如果竞争对手飞速前进,我们单方面承诺暂停训练没有意义。」

这不是技术判断,是生存判断。对于一家估值 3800 亿美元、正被 OpenAI、Google、xAI 围剿的公司,继续自我设限在商业上意味着掉队。从硬刹车到透明监控,中间差的不是技术认知,是囚徒困境下的生存本能。

生存本能

二、军事博弈:当安全红线遭遇国家意志

如果说 RSP 3.0 的调整是主动妥协,那么军事领域的博弈,则是一场真正的底线考验。

Anthropic 曾公开承诺:「拒绝参与全自主武器和国内大规模监控。」

2026 年 2 月 24 日,美国国防部长皮特·赫格塞斯当面向 Anthropic CEO 达里奥·阿莫迪下达了最后通牒:解除 Claude 模型的所有军事用途限制 (包括进攻性网络行动),否则将面临惩罚。截止时间是 2 月 27 日。

后果是什么?要么五角大楼动用 《国防生产法》 强制接管模型,要么将 Anthropic 列为供应链风险企业——这个标签通常用于敌对国家的公司,一旦贴上,Anthropic 将失去所有国防承包商的商业联系。

2 月 27 日,最后期限到来。阿莫迪未能及时与五角大楼敲定最终条款。截止时间刚过 14 分钟,赫格塞斯宣布谈判破裂,将 Anthropic 正式列为供应链风险。特朗普随后下令联邦机构停止使用 Anthropic 技术。

但故事没有在这里结束。

3 月 9 日,Anthropic 正式向加州联邦法院提起诉讼,指控美国政府的系列行动前所未有且不合法。3 月 26 日,加州北区联邦地区法院法官 Rita Lin 批准了 Anthropic 的初步禁制令申请,叫停了国防部的封杀令。法庭文件显示,Anthropic 提供了关键技术证据:其模型在部署于军方封闭环境后,公司本身无法远程控制——这一证据戳穿了五角大楼的安全风险指控。

Anthropic 守住了这条底线,至少在这一回合。

但问题依然存在:底线能守多久?法院的裁定只是初步禁制令,不是终局。五角大楼可以换一种方式再来。而 Anthropic 的客户名单里,依然有国防部的名字——那些作战规划和情报分析的合作,依然在继续。

三、内部管理的灯下黑

一个 CMS 配置失误,3000 份文件裸奔。

这不是黑客攻击,不是系统漏洞,是最基础的权限设置问题——和 AWS S3 存储桶忘记关权限一样低级。

剑桥大学研究员验证了泄露材料的真实性:员工育儿假记录、CEO 闭门峰会细节、甚至内部安全评估报告,全部暴露在互联网上。

泄露文件中有一句值得注意的话:「Mythos 预示着即将到来的一波模型浪潮,届时模型将以远超防御者努力的速度来利用漏洞。」 措辞之重,不像市场部写的,更像一份内部预警。

一家正在打造史上最强网络安全 AI 的公司,被最基础的权限配置失误暴露了内部文件。这种灯下黑的现象在科技史上并不罕见:苹果与 FBI 之争、微软补丁漏洞、Google 内部数据泄露——每一家科技巨头都犯过类似的错误。

但 Anthropic 的不同在于:它的核心价值就是安全。当一家以安全第一立身的公司,连自己的内部文件都保护不好,这本身就是一个值得追问的问题。

四、AI 安全的囚徒困境

RSP 3.0 的变化、国防部的最后通牒、CMS 的低级失误——这三件事拼在一起,勾勒出一个更深的困境:

AI 行业正在经历一场安全叙事的重构。

监管真空:政府没有建立统一的红线,导致企业不敢单方面踩刹车。

竞争压力:如果 OpenAI 和 Google 都在加速,任何一家公司的道德洁癖都可能变成竞争劣势。

叙事演化:安全正在从一种工程约束,变成一种公关语言。RSP 3.0 的透明披露,本质上是在告诉资本市场:我们还在意安全,但请不要让我们真的停下。

首席科学家 Jared Kaplan 的那句话,值得被反复讨论:

「如果竞争对手飞速前进,我们单方面承诺暂停训练没有意义。」

翻译过来就是:除非所有人一起踩刹车,否则谁先停,谁先死。这就是 AI 安全的最大悖论。在监管真空、竞争白热化的今天,没有一家公司敢做唯一的好人。

每个修改都有合理的解释。技术边界确实在模糊,监管环境确实在变化,商业竞争确实在加速。但问题是:当安全承诺可以被修改,它还是承诺吗?当人类在回路中成为免责声明,安全还有意义吗?

囚徒困境

五、对中国 AI 公司的启示

Anthropic 的困境,不是硅谷的孤例。中国 AI 公司同样面临 「安全 vs 商业」 的悖论。

不同的是,中国的监管环境更明确。网信办等部门的 AI 管理规定,为企业划定了相对清晰的红线。但红线清晰不代表没有压力。当字节跳动、阿里、百度等巨头加速迭代,创业公司同样面临 「别人都在跑,我不能站着」 的囚徒困境。

从 Anthropic 的教训中,中国 AI 公司可以带走三点:

第一,安全承诺需要可执行,不只是可传播。 RSP 3.0 的调整说明,安全一旦变成公关语言,就会失去可信度。承诺的价值不在于说得多漂亮,而在于能不能兑现。

第二,组织流程是安全的最后一道防线。 CMS 失误不是技术问题,是流程问题。再强的模型能力,也弥补不了最基础的权限管理漏洞。当公司全力追求模型能力的指数级增长时,基础架构的稳健性往往被忽视。

第三,底线需要提前划定,而不是临场博弈。 Anthropic 守住了拒绝全自主武器,但作战规划的合作依然存在。这条线划得清楚吗?如果提前划定,就不会被逼到墙角。对于中国 AI 公司来说,在监管框架内明确自己的安全底线,比在压力面前临时决策更主动。

结语

Anthropic 的泄露事件,最终会被修复。CMS 权限会被重新设置,泄露的文件会从互联网上消失,RSP 3.0 会继续执行。

但那个问题会一直存在:当一家以安全第一立身的公司,在资本压力和国家意志面前,一次次被逼到墙角,它还能守住多少底线?

Anthropic 用被制裁、被列为供应链风险的代价,守住了拒绝全自主武器这条线。但这条线能守多久?五角大楼会换一种方式再来吗?

答案从来不是模型更强、算力更大。答案是:把最基本的流程做好,把最基础的承诺守住。

这是 Anthropic 给整个 AI 行业上的一课。也是最难的一课——因为在这一课里,Anthropic 自己,既是那个抗争的学生,也是那个需要反思的学生。